AI#7 - ไม่ใช่สักแต่ว่าใหญ่

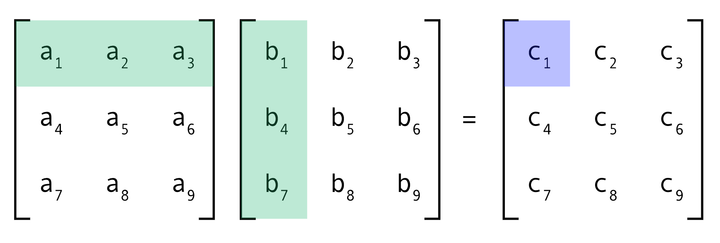

ในบทที่แล้วผมค้างไว้ตรงที่ว่า Neural Network นั้นมีความสามารถในการประมาณฟังก์ชันต่อเนื่องอะไรก็ได้ ซึ่งถือเป็นความสามารถระดับครอบจักรวาลเลย แต่การที่มีทฤษฎียืนยันว่าทำได้ไม่ได้แปลว่ามันจะทำได้ง่าย เพราะ Neural Network อันที่ทฤษฎีบอกว่ามีนั้นมันอาจจะมี Neuron เยอะมาก ๆ หรือมีหลาย Layer มาก ๆ จนใช้จริงไม่ได้ก็ได้ นั่นจึงเป็นเหตุผลที่ในทางปฏิบัติเราจึงต้องออกแบบหน้าตาของมัน

พอพูดว่าออกแบบหน้าตาของ Neural Network นั้น พื้นฐานเลยก็คือการกำหนดจำนวน Layer และกำหนดว่าแต่ละ Layer จะมีกี่ Neuron ซึ่งไม่มีกฎตายตัวว่าควรออกแบบยังไงถึงจะเวิร์ค แม้ว่ามันจะมี Rule of Thumb อยู่บ้างเล็ก ๆ น้อย ๆ แต่เท่าที่ผมทราบ จนถึงทุกวันนี้เราไม่ได้มีหลักตายตัวว่าปัญหาแบบไหนควรสร้าง Neural Network ขนาดเท่าไร

แต่หน้าตาของ Neural Network ไม่ได้เป็นแค่เรื่องของขนาดเพียงอย่างเดียว แต่ยังมีองค์ประกอบอื่น ๆ ที่เราใส่เข้าไปเพื่อให้ Neural Network มันทำงานได้ดีขึ้นด้วย